Компания ByteDance и Технологический университет Наньян (Сингапур) разработали систему StoryMem, которая помогает ИИ сохранять визуальную последовательность в видео. Ранее персонажи в сценах, сгенерированных нейросетями, могли менять внешность, одежду и окружение от кадра к кадру. Теперь эту проблему удалось решить.

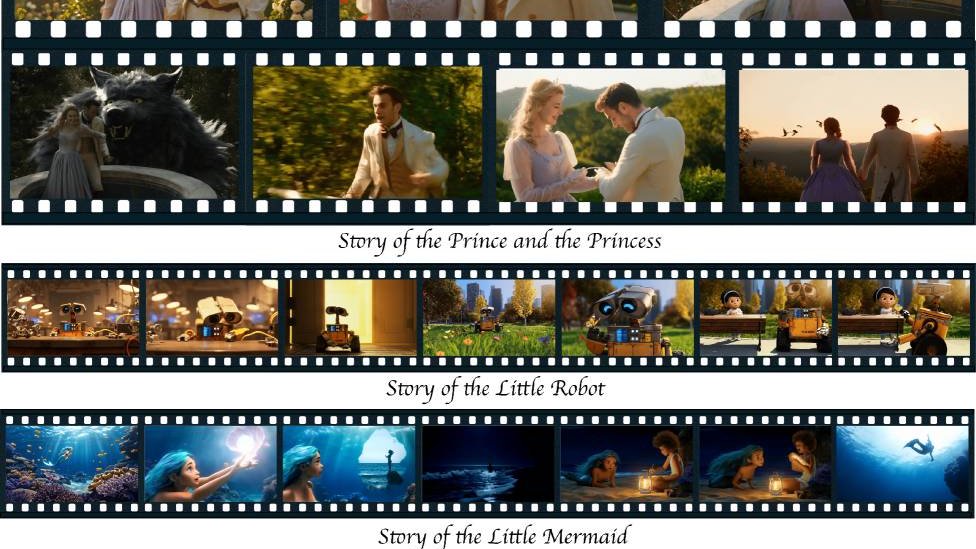

StoryMem сохраняет ключевые кадры из уже созданных сцен в специальной «памяти» и использует их как ориентир при генерации новых фрагментов. Это позволяет ИИ «вспоминать», как выглядели герои и локации ранее, обеспечивая целостность нарратива.

Разработчики обучили модель на 400 тысячах коротких видеороликов и провели тестирование по собственному бенчмарку ST-Bench. StoryMem улучшила согласованность изображения на 28,7% по сравнению с базовой моделью и на 9,4% по сравнению с предыдущим лидером HoloCine.

Система также загружает пользовательские изображения и использует их как основу для построения всей видеолинии. Исходный код и тестовый набор уже доступны для исследователей.